Zakažte vývoj autonomních zbraní, volají vědci z celého světa. Jejich výzvu podepsal i Elon Musk

Více než dvě tisícovky vědců a specialistů na umělou inteligenci se ve středu zavázaly, že nebudou podporovat vývoj a výrobu robotů, kteří by v budoucnosti mohli být využíváni k identifikaci a zabíjení bez lidského dohledu. Mezi signatáři je i výkonný ředitel společností SpaceX a Tesla Elon Musk.

'Lidská chybovost je 12 procent, robot chybu neudělá.' Jejich inteligence poroste, shodli se odborníci

Číst článek

Písemný závazek zveřejněný na webu bostonského institutu Future of Life je nejnovější akcí znepokojených vědců, kteří se snaží upozornit na rizika spojená s vývojem umělé inteligence. Volají v něm po předběžném zákazu smrtících autonomních zbraní (LAW), ze kterých by se v budoucnu mohly stát „zbraně hromadného ničení nové generace“, jak píše britský Guardian.

Text už stihlo podepsat přes dva a půl tisíce vědců a téměř dvě stovky firem. Vyzývá vlády a mezinárodní organizace k přijetí konkrétních norem, zákonů a regulací, které dostatečně podchytí a zakážou vývoj „vraždících robotů“. Vzhledem k absenci podobné legislativy se podepsaní odborníci zavazují k tomu, že se žádným způsobem nebudou podílet na podpoře, vývoji, výrobě ani obchodu spojeném s autonomními zbraněmi.

Odříznout černý trh

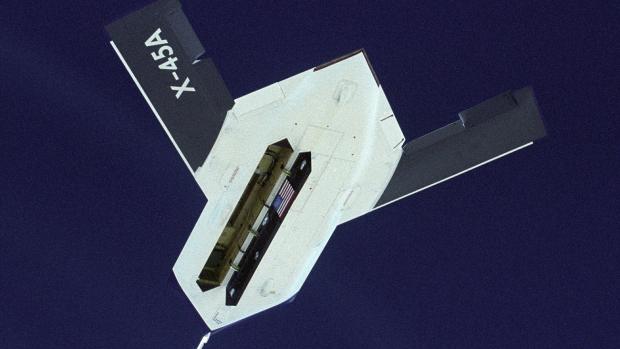

Armády jsou jedním z největších investorů do umělé inteligence (AI). Díky stále se zdokonalujícím počítačovým systémům mohou roboti, například díky bezpilotním letounům, pokrývat nepřátelská území. Výjimkou ale nejsou ani přesuny v terénu nebo hlídky v hlubinách moří. Podle Guardianu jsou další mnohem sofistikovanější zbraně aktuálně ve vývoji.

Závazek ke smrtícím autonomním zbraním

(...) My, níže podepsaní, vyzýváme vlády a vládní představitele k vytvoření budoucnosti se silnými mezinárodními normami, regulacemi a zákony vůči smrtelným autonomním zbraním. V současnosti chybí konkrétní opatření, a proto jsme se rozhodli udržet vysoký standard: nebudeme se podílet, ani podporovat vývoj, výrobu, obchod a užití těchto zbraní. Žádáme technologické společnosti a organizace, stejně tak světové vůdce, politiky a další jedince, připojte se k našemu závazku.

zdroj: The Future of Life Institute

Google zatím pro americké ministerstvo obrany vytváří speciální umělou inteligenci, která má armádě pomáhat s rozpoznáváním snímků z dronů. Server Gizmodo v červnu přinesl informaci, že se společnost rozhodla smlouvu s Pentagonem po roce 2019 dále neprodlužovat. K rozvázání poměru s vládou USA dovedla Google mimo jiné petice zaměstnanců, kteří se nechtěli na armádním projektu s krycím názvem „Maven“ podílet.

Daleko znepokojivější může být situace na černém trhu. „Pokud se chceme vyhnout tomu, aby nepřátelské státy nebo teroristé oplývali podobnými technologiemi, musíme prodej zakázat zbrojním společnostem,“ vysvětluje Toby Walsh, profesor umělé inteligence z Univerzity Nového Jižního Walesu v Sydney. „Rozhodne-li se někdo podobnou věc postavit a bude to v jeho silách, nedá se tomu zabránit. Stejně tak je tomu ale i s výrobou chemických zbraní,“ dodává.

‚Nakonec vyhrají stroje‘

Mezi podepsanými vědci je i jméno vynálezce Elona Muska. Ten se problematice AI věnuje mimo jiné i v rámci vývoje samořídicích automobilů ve firmě Tesla. O povinnosti regulovat umělou inteligenci mluví veřejně již několik let. Vloni například sdílel na svém twitteru obrázek s nápisem „nakonec vyhrají stroje“ a doplnil k němu svůj názor, že myslící počítače jsou pro svět větší hrozbou než celá Severní Korea.

Tweet byl reakcí na výhru Muskova vlastního AI softwaru, který v počítačové hře Dota 2 porazil nejlepší „lidský“ tým světa. „Je to mnohem komplexnější hra než šachy nebo Go,“ poznamenal.

Ani nedávno zesnulý teoretický fyzik Stephen Hawking nepatřil k fanouškům umělé inteligence. V listopadu 2017 se na konferenci v Portugalsku k této nastupující technologii vyjádřil spíše skepticky. „Vytvoření funkční umělé inteligence může být největší událostí v dějinách naší civilizace. Nebo nejhorší. Jednoduše nevíme. Nevíme proto, zda nám umělá inteligence nesmírně pomůže, nebo nás bude ignorovat, odstrčí nás či nás zničí.“